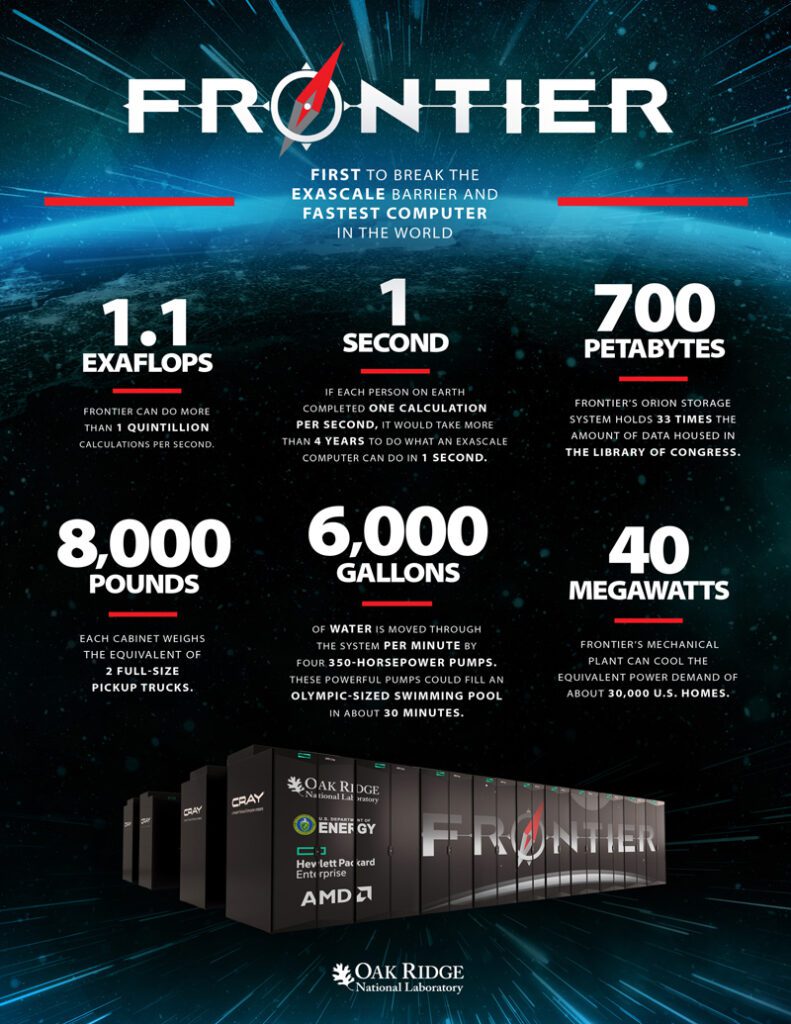

/HPE FRONTIER – Najpotężniejszy superkomputer na świecie.

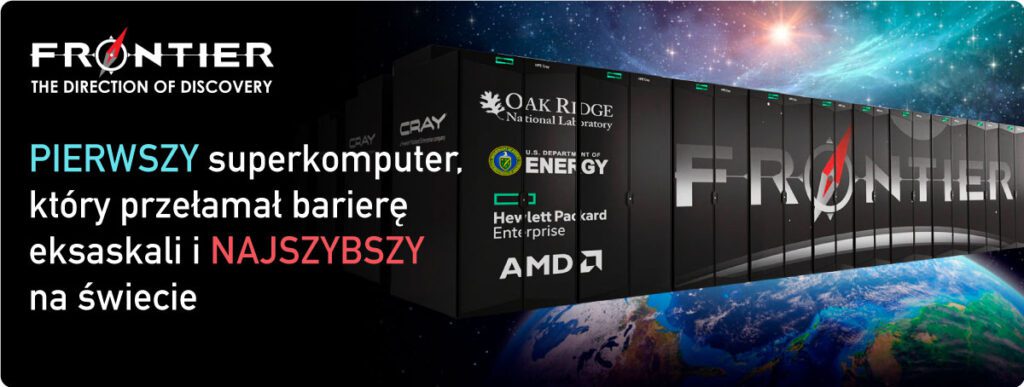

Superkomputer Hewlett Packard Enterprise (HPE) Frontier jest jednym z najpotężniejszych superkomputerów na świecie. Został opracowany we współpracy z amerykańskim Departamentem Energii (DOE) i znajduje się w Oak Ridge National Laboratory w stanie Tennessee w USA. Superkomputer Frontier został zaprojektowany, aby pomóc naukowcom w rozwiązywaniu najbardziej złożonych i palących problemów z różnych dziedzin, w tym medycyny, nauk o klimacie i energii.

Specyfikacja techniczna

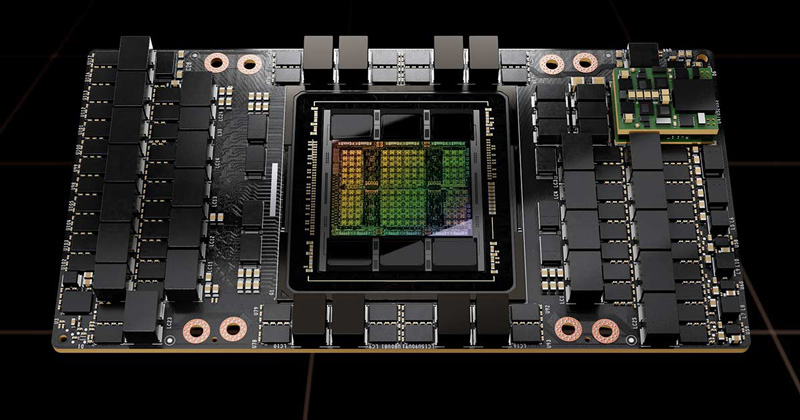

Superkomputer HPE Frontier został zbudowany w oparciu o architekturę superkomputera HPE Cray EX, która składa się z kombinacji procesorów AMD EPYC i procesorów graficznych NVIDIA A100. Jego szczytowa wydajność wynosi 1,5 eksaflopsów (jeden kwintylion operacji zmiennoprzecinkowych na sekundę) i może wykonywać ponad 50 000 bilionów obliczeń na sekundę. System posiada 100 petabajtów pamięci masowej i może przesyłać dane z prędkością do 4,4 terabajtów na sekundę.

Zastosowania

Superkomputer HPE Frontier jest wykorzystywany do wielu zastosowań, w tym do modelowania klimatu, materiałoznawstwa i astrofizyki. Jest również wykorzystywany do opracowywania nowych leków i metod leczenia chorób takich jak rak i COVID-19.

Modelowanie klimatu

Superkomputer Frontier jest wykorzystywany do poprawy naszego zrozumienia systemu klimatycznego Ziemi oraz do opracowania dokładniejszych modeli klimatycznych. Pomoże to naukowcom przewidzieć wpływ zmian klimatu i opracować strategie łagodzenia ich skutków.

Materiałoznawstwo

Superkomputer jest również wykorzystywany do modelowania i symulacji zachowania materiałów na poziomie atomowym i molekularnym. Pomoże to naukowcom opracować nowe materiały o unikalnych właściwościach, takich jak zwiększona wytrzymałość, trwałość i przewodność.

Astrofizyka

Superkomputer Frontier jest wykorzystywany do symulacji zachowania wszechświata na dużą skalę, w tym formowania się galaktyk i ewolucji czarnych dziur. Pomoże to naukowcom lepiej zrozumieć naturę wszechświata i siły, które nim rządzą.

Rozwój leków

Superkomputer jest wykorzystywany do symulacji zachowania cząsteczek biologicznych, takich jak białka i enzymy, w celu opracowania nowych leków i sposobów leczenia chorób. Pomoże to naukowcom zidentyfikować nowe cele dla rozwoju leków i opracować bardziej skuteczne metody leczenia szerokiego zakresu chorób.

Podsumowanie

Superkomputer HPE Frontier stanowi duży krok naprzód w rozwoju obliczeń o wysokiej wydajności. Jego bezprecedensowa moc obliczeniowa i pojemność pamięci masowej sprawiają, że jest on cennym narzędziem dla naukowców z wielu dziedzin. Jego zdolność do symulowania złożonych systemów na wysokim poziomie szczegółowości pomaga nam lepiej zrozumieć otaczający nas świat i opracować rozwiązania dla niektórych z najbardziej palących wyzwań stojących przed ludzkością.